© IStock

"Les équipes soignantes et les patients ne doivent pas se priver des avantages apportés pas ces outils, tout en se donnant constamment les moyens de prendre de la distance avec le résultat fourni", résument le Comité national pilote d'éthique du numérique (CNPEN) et le Comité consultatif national d'éthique pour les sciences de la vie et de la santé (CCNE) dans un avis commun publié aujourd’hui.

Surtout, l'intelligence artificielle appliquée au diagnostic médical doit toujours être utilisée "en priorité dans une optique d'amélioration du soin, avant les intérêts organisationnels, économiques, ou managériaux", insistent les deux comités.

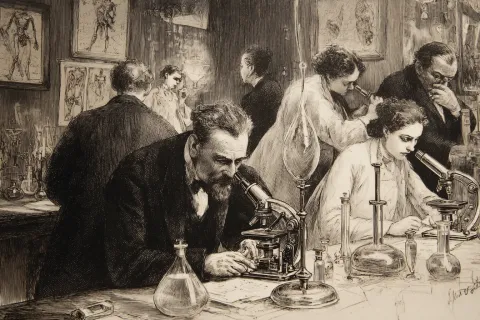

Cet avis, assorti de seize recommandations et sept points de vigilance, est le résultat d'une saisine par le Premier ministre dans une lettre de mission du 15 juillet 2019 portant sur "les enjeux d'éthique de l'utilisation de l'intelligence artificielle (IA) dans le champ du diagnostic médical".

"Le secteur de la santé et de la médecine est particulièrement concerné par le développement de systèmes d'intelligence artificielle", souligne l'avis.

Côté bienfait, ces technologies permettent par exemple d'identifier des lésions échappant à l'œil humain, de rapidement traiter des cas aisés à diagnostiquer mais répétitifs, tout en libérant du temps médical pour échanger avec le patient.

Mais l'IA appliquée au diagnostic médical produit aussi "des résultats basés d'une part sur des approches qui peuvent être probabilistes et d'autre part peuvent être entachés d'erreurs"

Mais l'IA appliquée au diagnostic médical produit aussi "des résultats basés d'une part sur des approches qui peuvent être probabilistes et d'autre part peuvent être entachés d'erreurs", alertent-ils.

Elle suggère en outre une transformation de la relation entre médecins et patients et ouvre de nombreuses questions – éthiques notamment – sur l'avenir des systèmes de santé, avec "des enjeux hétérogènes voire parfois contradictoires, entre intérêts économiques et industriels, promesses thérapeutiques pour les patients, modification de la pratique professionnelle des personnels de santé concernés et objectifs de régulation pour les autorités publiques", estiment les deux comités.

Dans ce contexte, "le contrôle de conformité du système d'IA, qui assure qu'il n'est pas dangereux et ainsi autorise sa mise sur le marché, doit être amélioré, et surtout doit à l'avenir être accompagné d'une évaluation (...) montrant non seulement son absence de nocivité mais aussi qu'il contribue efficacement au principe de bienfaisance", plaident-ils.

Avec AFP